ニュース

2025.05.21 専門分野コラム人間の知能とAIの「知能」その2 -言葉を操るのには意味の理解が必要か-

ライフデザイン学科教員の相場です。

前回に引き続き、人間の知能とAIの「知能」の関係を取り上げています。前回の「ペンローズの議論をめぐるAIとの対話」では、まずペンローズの主張をめぐるChatGPTと私のディスカッションについて紹介しました。

第1回目の内容を簡単にふりかえっておきます。ペンローズの主張の要点は次のようなものです:あるアルゴリズムによって人間の知能がシミュレート可能だと仮定します。アルゴリズムには対応する形式的体系(公理系)があり、この体系の中では、その証明も否定の証明もできないゲーデル命題が存在します。あるアルゴリズムにとっては、対応する体系のゲーデル命題は扱えないのです。一方、人間はそのゲーデル命題の意味(「この命題は証明できない」となります)を読み取ることにより、ゲーデル命題が真であることが理解できます。これは矛盾です。あるアルゴリズムが人間の知能をシミュレートできるとすると、そのアルゴリズムのゲーデル命題が真であることを理解できるはずですから。したがって人間の知能はいかなるアルゴリズムによってもシミュレートできないという結論になります。これを人間の知能の「非アルゴリズム仮説」と呼びましょう。

これに対するChatGPTの議論(疑問や反論)は次のようなものでした:ゲーデル命題の議論は数学的素養のある人にしか通用しないので、これが「人間の本質」がどうか疑問。AIにとってゲーデル命題は証明も否定の証明もできないが、それでも「意味的に真だと考えられる」と判断できるようになるかもしれない。人間の理解を生み出すとされている肝心のアルゴリズム的ではない過程がどういうものかは不明。

というわけで、実は、ChatGPTもまだ非アルゴリズム仮説を完全に否定しているわけではありません。非アルゴリズム仮説は、①人間の知能の本質は「意味を理解すること」、そして、②「意味を理解する」というのが何を意味するのかというと「ゲーデル命題が真だとわかること」だと簡潔・明快に言い切っています。知能をめぐってはけっこうあいまいな議論が多い中で、この簡潔さ・明快さは魅力です。したがって、私としてはまだまだ非アルゴリズム仮説を捨てることはやめておくことにします。

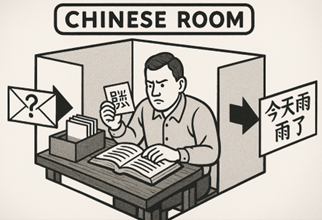

さて、次に、意味の理解と関連して、「言葉を操るためには意味を理解していなくてはならない」という仮定について考えてみましょう。これは、私たちがなんとなく、そうだろうと思っていた仮定です。この仮定を検討するためには「中国語の部屋」の問題が最適です。「中国語の部屋」ではデフォルメしたコンピュータが登場します。そこで、「中国語の部屋」に行く前に、少し脱線してデフォルメしたコンピュータの例を取り上げましょう。

私たちが使っているコンピュータは半導体をもとにした素子で作られていますが、別にコンピュータは何から作られていてもいいのです(コンピュータのアイデアのもとになったチューリングマシンはテープとヘッド、その他からできています)。実際、最初の電子計算機と言われる「エニアック」は真空管でできていました。真空管でなくても、歯車から作ってもいいわけです。さらに飛躍(!)すれば、人間を素子としても問題ありません。

「三体」(劉慈欣著)というSF小説には「人列コンピュータ」という、人を素子としたコンピュータが出てきます。簡単に紹介しましょう。3人一組となり、3人のうち2人を「入力1」「入力2」、もう一人を「出力」と呼びます。3人はそれぞれ白旗と黒旗を持っています。そして、「出力」は「入力1」「入力2」を監視していて、二人がどちらも黒旗を上げていたら自分も黒旗を上げます。一方、「入力1」「入力2」が上げている旗がその他の組み合わせの場合自分は白旗を上げます。これで3人一組のANDゲートの出来上がりです。この調子で人間の3人組あるいは2人組を利用してORゲート、NANDゲート、NOTゲート等必要なゲートを作ることができます。こうして6キロメートル四方の広大な大地に3千万人の人間を集めて「人列コンピュータ」を作ります。この「人列コンピュータ」を利用して星の軌道計算を行おうというわけです・・・。なんとも壮大なスケールの話ですね。「三体」についてはこれくらいにしておきましょう。

要するに人間を部品にしてもコンピュータは作れるということです。

それでは「中国語の部屋」の問題です。私が図書館長をしていた頃に図書館報「葛野の鐘」(2017年)に書いた文章を用いて説明します。

「ある日、英語しか理解できない館長が、1冊の本を渡され、小部屋に入るよう指示されました。入ると、小さな窓から紙が挿入されます。その紙には中国語が書いてあるのですが、館長には奇妙な記号の羅列にしか見えません。そこで渡された本を見ると、そこには、こういう記号列を渡されたら、こういう記号列を書いて渡せということがたくさん書いてありました。館長は本を見て、わけはわからないまま記号の列を書いて渡しました。そのようなやり取りがしばらく続いた後、小部屋のドアが開くと、そこには中国語が堪能な学長が立っていました。「いや驚いた。君は中国語もOKなんだね」館長は戸惑いました。実際彼は中国語を一切理解していないし、単に渡された本にしたがって機械的に反応していただけですから。これは「中国語の部屋」という有名な話で、コンピュータに「理解」はあるか、あるいは、この本のような中国語のマニュアルはそもそも存在しうるのかという論争を巻き起こしました」

もし、非アルゴリズム仮説に加えて、「言葉を操るためには意味を理解していなくてはならない」という仮定も正しいとするとどういうことになるでしょうか。非アルゴリズム仮説が意味しているのは、意味を理解するということはアルゴリズム的には達成できないということでした。さらに、仮定によると、言葉を操るためには意味の理解が必要だというわけですから、これは言葉を操ることはアルゴリズム的には達成できないということを意味します。一方、上の話にあるような中国語のマニュアルが存在するとするならば、言葉をアルゴリズム的に操れることになってしまいます。したがって、中国語をはじめ、言葉を操るためのマニュアル、すなわちアルゴリズムは存在しないということになります。非常にすっきりしたわかりやすい結論です。・・・ただし、ChatGPTが登場するまでは・・・。

いよいよChatGPTの登場です。ChatGPTがどんなにすごくても、どんなにたくさんのパラメータを持っていても、どんなに訓練に時間とお金がかかっても、要はただのプログラムであり、アルゴリズムです。ところがそのようなChatGPTが人間の言葉を自在に操ることができています。そのクオリティは「その1」で紹介した通りです。これは、上の段落で述べた仮定が間違っていることを意味します。つまり、非アルゴリズム仮説が間違っているか、「言葉を操るためには意味を理解していなくてはならない」が間違っているか、あるいはその両方が間違っているかということです。もし非アルゴリズム仮説をまだ捨てないとすると、「言葉を操るためには意味を理解していなくてはならない」が間違っているということになります。要するに意味を理解していなくても言葉は操れるということです。衝撃的な結論ではないでしょうか。

数学ソフト「Mathematica」の開発で有名な物理学者スティーブン・ウルフラムも「ChatGPTの頭の中」という本の中で次のように述べています。「小論文の執筆のように、人間にはできてもコンピュータにはできないと考えられてきた処理が、実は計算処理の点から考えると、ある意味では思っていたより容易だということだ。言い換えるなら、ニューラルネットがうまく小論文を書けるのは、小論文の執筆というのが、これまで考えられていたより「計算処理的に浅い」問題だったからなのである」

(非アルゴリズム仮説によると)人間の知能とAIの「知能」は異なります(ゲーデル命題を理解できるかどうかという点で)。ところがAIも人間と同じように言葉を操れます。一体、人間の知能とAIの「知能」はどういう関係になるのでしょうか、どう理解すればいいのでしょうか。・・・どうも字数が尽きたようです。続きは「その3」で展開したいと思います。